Written by

chenylvia

on

on

Ollama使用教程

Ollama是一个开源工具,用于本地运行大模型,它的特点是使用简单,配置方便。本文介绍如何使用Ollama。

一、安装Ollama

- Windows / MacOS

访问Ollama官方网站下载安装包。

- MacOS

brew install ollama

- Linux

curl -fsSL https://ollama.com/install.sh | sh

- Docker

拉取Docker镜像:

docker pull ollama/ollama

安装完成后,执行如下命令查看版本号:

ollama -v

查看使用说明:

ollama -h

结果:

Usage:

ollama [flags]

ollama [command]

Available Commands:

serve Start ollama

create Create a model from a Modelfile

show Show information for a model

run Run a model

stop Stop a running model

pull Pull a model from a registry

push Push a model to a registry

list List models

ps List running models

cp Copy a model

rm Remove a model

help Help about any command

Flags:

-h, --help help for ollama

-v, --version Show version information

Use "ollama [command] --help" for more information about a command.

Ollama基于客户端-服务端架构,执行ollama serve开启服务端。

二、运行模型

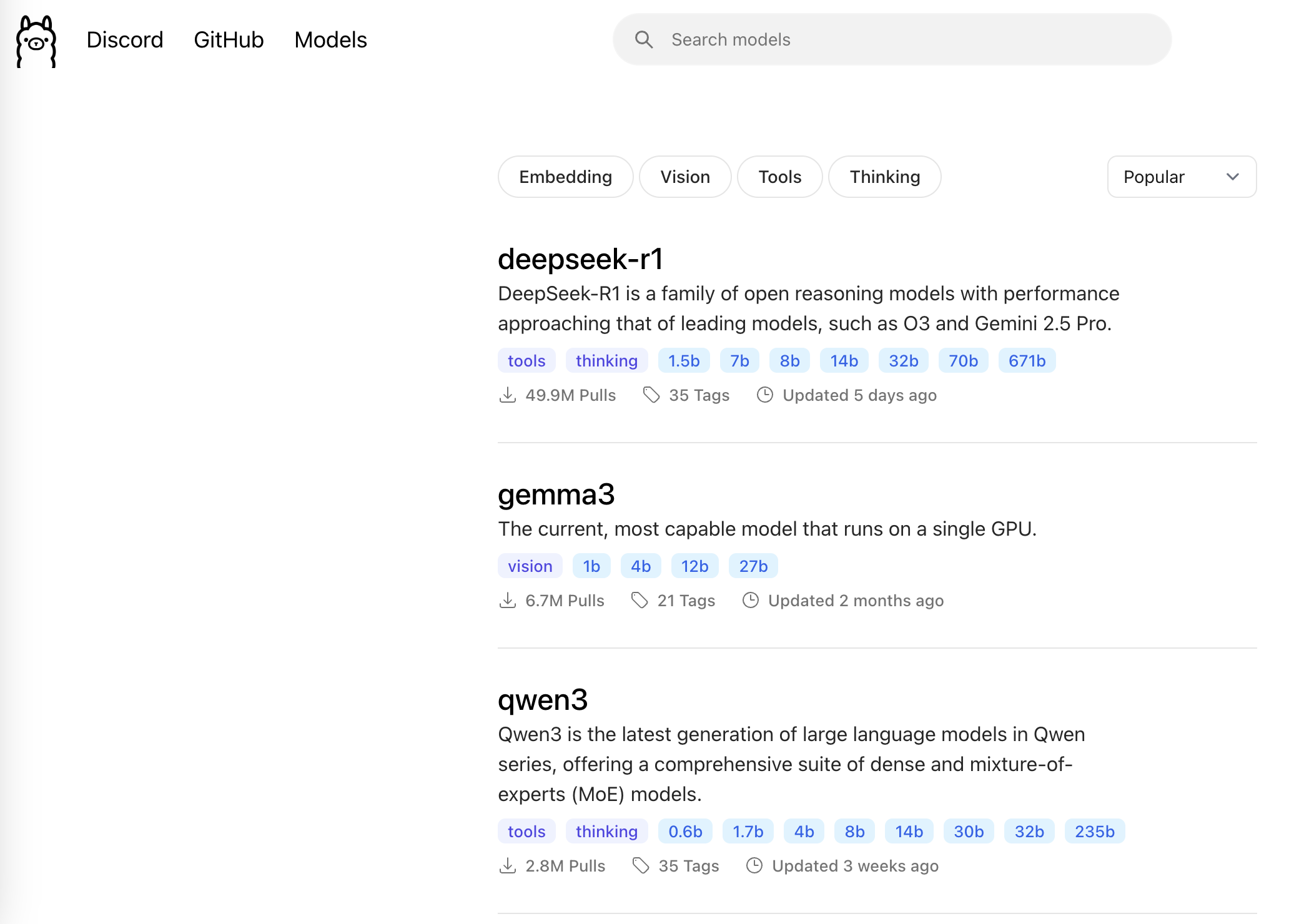

Ollama支持多个模型,例如deepseek-r1和qwen3等,可访问官网模型入口查看具体模型。

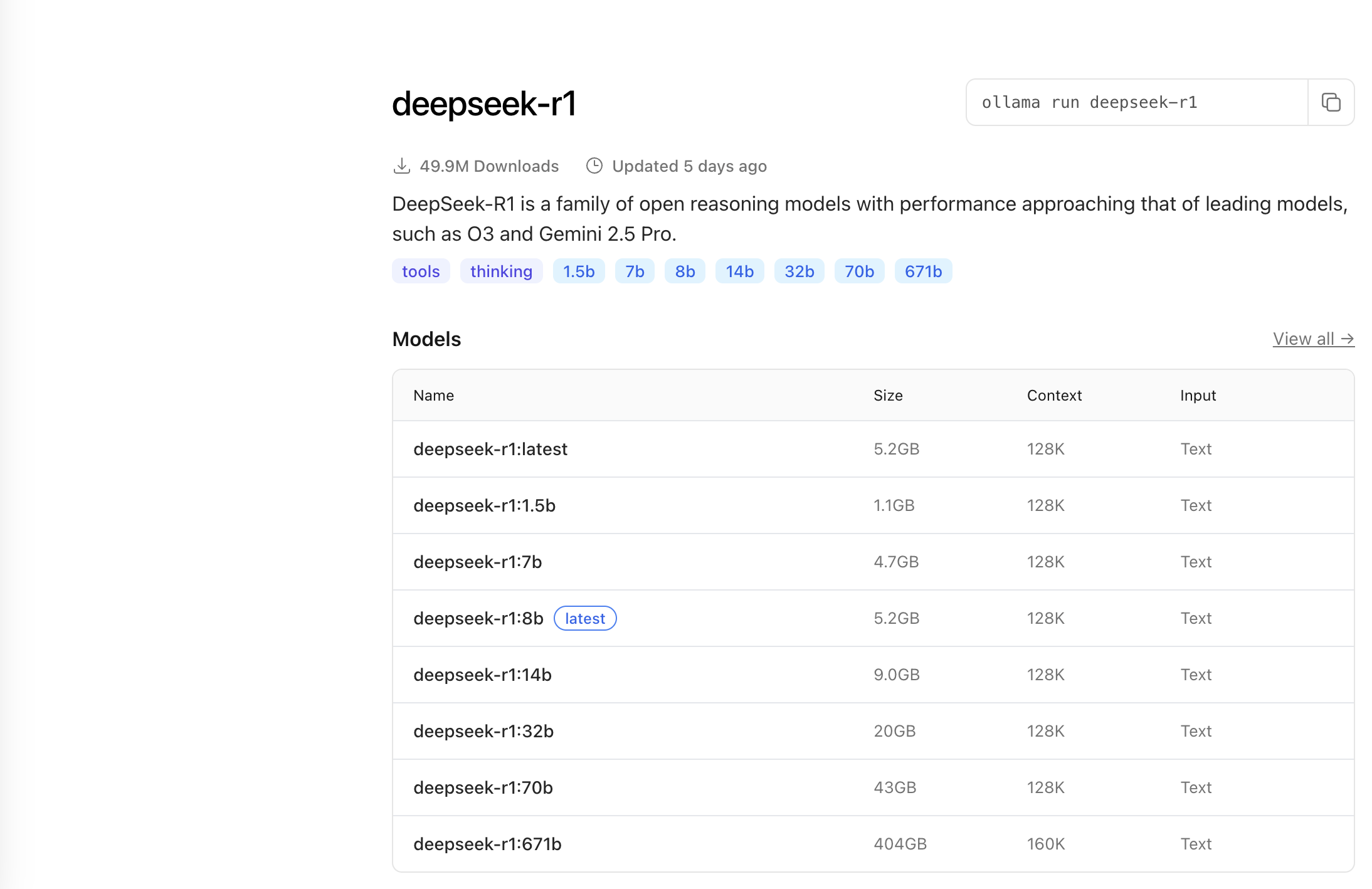

点击模型名称,可以看到不同类型的模型:

下载模型:

ollama pull <模型名称>

查看已下载模型:

ollama list

查看模型信息:

ollama show <模型名称>

运行模型(如果本地没有该模型,则会先进行下载):

ollama run <模型名称>

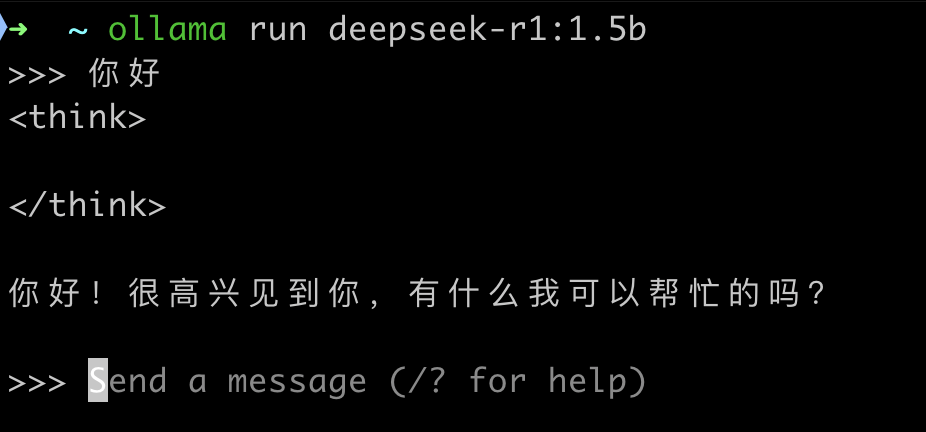

以deepseek-r1:1.5b模型为例,本地运行后,出现命令行交互界面,输入问题后模型返回结果:

三、自定义模型

Ollama支持创建自定义模型,并且提供了Modelfile文件来管理模型配置,使用自定义模型的好处是可以根据自己需求进行个性化配置。

通过现有模型创建自定义模型:

ollama create <自定义模型名称> -f <Modelfile>

Modelfile是模型配置文件,用于定义和管理模型,可以在其中配置模型温度和随机种子等。

将自定义模型推送到模型库:

ollama push <自定义模型名称>

四、总结

通过使用Ollama工具,可以很方便地下载和运行模型。Ollama也提供了基于HTTP的API,开发者可通过接口调用的方式和模型进行交互。总之,Ollama类似于软件应用中的Docker,简化了本地配置和部署模型的流程。

Discussion and feedback